Informations Générales sur Stable Diffusion 2

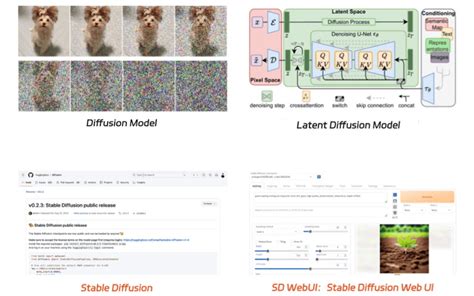

Stability AI, une entreprise pionnière dans le domaine de l'intelligence artificielle, a annoncé la disponibilité publique de son IA générative Stable Diffusion (SD) le 22 août 2022. Stable Diffusion est un modèle d'apprentissage automatique capable de générer des images numériques de différents styles, y compris photoréalistes, à partir de descriptions en langage naturel. Cette IA se positionne comme un concurrent direct de DALL-E 2 et Midjourney, mais avec l'avantage notable d'être Open Source. Cette ouverture permet aux utilisateurs de consulter, modifier et exécuter le code source sur leur propre machine, favorisant ainsi une communauté dynamique et une innovation rapide.

Stable Diffusion est le fruit d'une collaboration étroite entre Stability AI, EleutherAI et Laion, utilisant la base de données LAION-Aesthetics pour produire des images à partir de requêtes textuelles. Sa flexibilité le rend utile dans de nombreux domaines, tels que la création artistique, le concept art, les chartes graphiques, les brouillons et les croquis. L'IA permet également la transformation d'images en y ajoutant un style ou une contrainte spécifique fournie par l'utilisateur sous forme de texte.

Points Essentiels de Stable Diffusion 2

Stable Diffusion 2.0 apporte des améliorations et de nouvelles fonctionnalités significatives par rapport à ses prédécesseurs. L'un des changements les plus importants est le remplacement de l'encodeur de texte. Alors que Stable Diffusion 1 utilisait CLIP d'OpenAI, dont le jeu de données d'entraînement n'est pas publiquement disponible, Stable Diffusion 2 adopte OpenCLIP. OpenCLIP est une version open-source de CLIP, entraînée sur un sous-ensemble esthétique de LAION-5B, filtré pour exclure le contenu NSFW (Not Safe For Work). Stability AI affirme qu'OpenCLIP améliore considérablement la qualité des images générées.

Changements Clés et Comparaison avec Stable Diffusion 1

Le passage de CLIP à OpenCLIP est la source de nombreuses divergences observées entre Stable Diffusion 1 et 2. Les utilisateurs ont noté une capacité apparemment réduite de SD 2 à représenter des célébrités ou des styles artistiques par rapport à SD 1.5. Cela s'explique par le fait que le jeu de données de CLIP contenait plus d'images de célébrités et d'artistes que le jeu de données LAION. Par conséquent, de nombreuses méthodes de prompting utilisées avec SD 1.5 sont moins efficaces avec SD 2.

Malgré ces différences, Stability AI a investi plus d'un million d'heures en A100 pour créer une base solide pour SD 2. Ce changement vers un modèle entièrement open-source et basé sur des données ouvertes marque une étape importante, plaçant la responsabilité du développement des capacités futures entre les mains de la communauté open-source.

Prompting Négatif et Textual Inversion

L'importance du prompting négatif semble être accrue dans Stable Diffusion 2 par rapport à SD 1. L'utilisation de prompts négatifs, tels que "ugly, tiling, poorly drawn hands, poorly drawn feet, poorly drawn face, out of frame, mutation, mutated, extra limbs, extra legs, extra arms, disfigured, deformed, cross-eye, body out of frame, blurry, bad art, bad anatomy, blurred, text, watermark, grainy", améliore considérablement la qualité des images générées par SD 2, bien que les performances globales restent parfois inférieures à celles de SD 1.5.

De plus, Stable Diffusion prend en charge la textual inversion. Cette méthode permet d'utiliser un petit nombre d'images de référence pour générer un nouveau "mot" qui représente ces images. Ce "mot" peut ensuite être utilisé dans les prompts pour générer des images fidèles aux références, combinées à d'autres concepts sémantiques. L'utilisation de la textual inversion améliore significativement les performances de Stable Diffusion 2.0.

Représentation des Célébrités et Styles Artistiques

En raison de la moindre présence d'images de célébrités dans le jeu de données LAION par rapport à celui de CLIP, SD 2 peut présenter des difficultés accrues dans la génération d'images de célébrités par rapport à SD 1.5. Bien que les performances soient comparables pour des prompts simples comme "keanu reeves", elles peuvent se dégrader lorsque les célébrités sont combinées à d'autres concepts sémantiques. SD 1.5 a tendance à mieux performer dans ces cas complexes.

De même, la génération d'images stylisées, notamment dans le style d'artistes spécifiques comme Greg Rutkowski, est plus difficile avec SD 2 "out of the box". SD 1.5 s'avère être le vainqueur clair dans la reproduction de ces styles artistiques.

Cohérence du Texte

Un domaine où Stable Diffusion 2 pourrait avoir un avantage par rapport à Stable Diffusion 1 est la cohérence du texte. Bien que la plupart des modèles texte-image aient du mal à représenter le texte de manière fiable, SD 2 semble légèrement meilleur dans ce domaine. Les résultats ne sont pas encore parfaits, mais l'on peut argumenter que SD 2 est légèrement supérieur.

Autres Modèles et Fonctionnalités de Stable Diffusion 2

Outre le changement d'encodeur de texte, Stable Diffusion 2 a été lancé avec plusieurs autres fonctionnalités notables :

- Modèle de Profondeur (Depth Model) : Ce modèle prend une image 2D et renvoie une carte de profondeur prédite. Ces informations peuvent être utilisées pour conditionner la génération d'images, permettant de créer de nouvelles images fidèles à la géométrie d'une image de référence.

- Modèle d'Upscaling : Stable Diffusion 2 intègre un modèle d'upscaling capable d'augmenter la résolution des images d'un facteur quatre, résultant en des images avec 16 fois plus de pixels que l'original.

- Modèle d'Inpainting : Un modèle d'inpainting mis à jour permet de modifier des sous-sections d'une image de manière esthétiquement cohérente.

- Modèle 768x768 : Stable Diffusion 2 prend en charge la génération d'images à une résolution de 768x768 pixels, offrant une surface d'image plus de deux fois supérieure à celle de 512x512 pixels de Stable Diffusion 1.

Stable Diffusion 2.1 : Améliorations et Ajustements

Stable Diffusion 2.1 a été publié peu après la version 2.0, dans le but de corriger plusieurs de ses lacunes par rapport à SD 1.5. La modification la plus significative concerne le filtre NSFW. SD 2.0 utilisait un filtre qui réduisait la capacité du modèle à représenter des personnes. SD 2.1 utilise un filtre moins restrictif, ce qui augmente la quantité de données d'entraînement et améliore la capacité du modèle à générer des images de personnes.

Les tests montrent que Stable Diffusion 2.1 est une amélioration notable par rapport à SD 2.0, étant capable de représenter des célébrités de manière plus fidèle et avec une meilleure texture de peau, surpassant même SD 1.5 dans certains cas. Cependant, la capacité de SD 2.1 à reproduire des styles artistiques spécifiques reste inférieure à celle de SD 1.5.

Utilisation et Accessibilité de Stable Diffusion

Il existe plusieurs façons d'accéder à Stable Diffusion :

- Dreamstudio : L'interface la plus simple et conviviale, utilisable directement sur les serveurs de Stability AI. Elle nécessite une inscription et offre des crédits gratuits pour tester l'IA, avec la possibilité d'en acheter davantage.

- Hugging Face : Une plateforme en ligne gratuite pour utiliser Stable Diffusion, bien que les serveurs puissent être surchargés, entraînant des temps de génération plus longs.

- Installation Locale sur PC :

- GRisk GUI (GPU Nvidia) : Une solution simple pour les utilisateurs disposant d'une carte graphique Nvidia compatible CUDA.

- Google Colab : Une option gratuite pour les utilisateurs sans GPU Nvidia, permettant d'exécuter du code via des carnets de notes en ligne, avec sauvegarde sur Google Drive.

La licence du modèle, CreativeML Open RAIL-M, permet une utilisation libre des résultats générés, à condition de respecter certaines dispositions interdisant les usages illégaux, préjudiciables ou discriminatoires. Les entreprises commerciales dont le chiffre d'affaires dépasse un million de dollars peuvent nécessiter une licence d'entreprise spécifique.

Avantages de Stable Diffusion

- Open Source : L'accès au programme est gratuit.

- Personnalisable : Possibilité de modifier le code source pour ceux qui ont les compétences techniques.

- Communauté Active : Une communauté d'utilisateurs large et dynamique qui partage des améliorations et des modèles personnalisés.

- Performances en Amélioration Constante : Les résultats s'améliorent de jour en jour.

- Concurrence : Un concurrent sérieux face à Midjourney et DALL-E 2, offrant des avantages distincts comme la gratuité et la possibilité d'une utilisation locale.

Modèles et Architectures Récentes

Stability AI continue d'innover avec des versions et des architectures améliorées :

- SDXL-Turbo : Une version distillée publiée en novembre 2023, permettant la génération d'images en temps réel. Sa licence initiale ne permet pas un usage commercial et la version originale génère des images de 512x512 pixels.

- Stable Cascade : Publié en février 2024, ce modèle est construit sur l'architecture Würstchen et fonctionne dans un espace latent beaucoup plus petit, offrant une grande efficacité. Il atteint un facteur de compression de 42, ce qui le rend adapté aux utilisations où l'efficacité est primordiale.

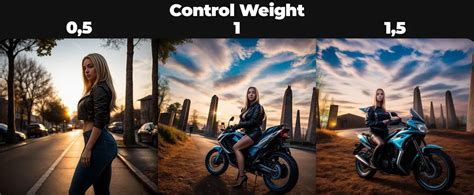

- ControlNet : Une structure de réseau neuronal qui ajoute un conditionnement spécifique aux images générées par Stable Diffusion à partir de texte. ControlNet utilise une image de référence pour guider la génération en passant par des préprocesseurs (détection de contours, de profondeur, de pose, etc.).

Stable Diffusion est formé sur un sous-ensemble du jeu de données LAION-Aesthetics V2. Les modèles récents continuent de repousser les limites de la génération d'images par IA, offrant de nouvelles possibilités créatives et techniques.

tags: #stabilityai #stable #diffusion #2