Stable Diffusion 3 : Benchmark et Analyse Approfondie

Stable Diffusion 3 (SD3) représente une évolution majeure dans le domaine de la génération d'images par IA, marquant un tournant par rapport aux architectures précédentes. Cette nouvelle itération, lancée par Stability AI, introduit des avancées significatives en matière de compréhension des prompts, de rendu de texte et de qualité d'image globale, tout en posant de nouvelles questions sur la performance et l'éthique.

Architecture et Innovations Techniques

La famille Stable Diffusion 3, dont la version 3.5 a été publiée en juin 2024, se distingue par l'adoption de l'architecture **Multimodal Diffusion Transformer (MMDiT)**. Cette approche rompt avec l'architecture U-Net traditionnelle des modèles précédents comme Stable Diffusion 1.5 et SDXL, qui héritait de l'imagerie médicale.

Le Passage aux Transformers Multimodaux (MMDiT)

Contrairement aux modèles de diffusion classiques qui ajoutent progressivement du bruit à une image avant d'apprendre à inverser ce processus, SD3 s'appuie sur une technologie moderne appelée "Rectified Flow". Cette méthode utilise des transformations continues et plus fluides pour générer des images, offrant une approche plus directe et potentiellement plus efficace.

L'architecture MMDiT gère de manière indépendante les représentations textuelles et visuelles grâce à des jeux de poids distincts pour l'image et le texte. Cela permet un dialogue plus fluide entre les deux modalités, améliorant la compréhension des prompts complexes.

Encodeurs Textuels Multiples

Pour améliorer la compréhension du langage, SD3 emploie trois encodeurs textuels fonctionnant en parallèle : deux modèles CLIP (CLIP-G/14 et CLIP-L/14) et un encodeur T5 XXL. Ensemble, ces encodeurs représentent environ 5 milliards de paramètres dédiés à l'interprétation du texte, une amélioration notable par rapport aux versions précédentes.

Mécanisme d'Attention Bidirectionnelle

Au lieu du mécanisme d'attention croisée traditionnel où le texte conditionne la génération d'images dans une seule direction, le MMDiT concatène les projections d'entrée des deux modalités (texte et image). Une seule opération d'attention unifiée est ensuite effectuée, permettant un flux d'informations bidirectionnel. L'architecture implémente également la Query-Key Normalization dans ses blocs de transformeurs.

Variational Autoencoder (VAE) Amélioré

Pour le VAE, SD3 utilise une implémentation à 16 canaux, comparativement aux 4 canaux des modèles précédents. Cela contribue à une meilleure représentation des détails et des subtilités dans les images générées.

Performances et Capacités de Stable Diffusion 3

Stable Diffusion 3, en particulier ses variantes comme SD3 Medium (2.5 milliards de paramètres) et SD3 Large (8.1 milliards de paramètres), montre des avancées notables dans plusieurs domaines clés.

Rendu de Texte Amélioré

L'un des points faibles historiques des modèles de diffusion était la génération de texte lisible dans les images. SD3 a fait des progrès spectaculaires dans ce domaine, surpassant ses concurrents directs tels que DALL-E 3 et Midjourney v6 dans les évaluations de préférence humaine pour la typographie.

Meilleure Adhérence aux Prompts

SD3 suit plus fidèlement les instructions complexes des prompts. L'attention bidirectionnelle et l'encodage textuel étendu permettent au modèle de mieux gérer les prompts multi-sujets et les relations entre les éléments.

Par exemple, lors de la génération d'une voiture de sport violette sur les Champs-Élysées, SD3 a réussi à produire une image cohérente et fidèle au prompt.

Prompt : A purple sports car speeds along the Champs Elysées in Paris. Photorealistic.

Génération de Texte Intégré

Le modèle gère de manière assez fidèle l'intégration de texte dans les images. Un test consistant à demander la génération d'un journal avec un titre spécifique a été réussi avec brio.

Prompt : A penguin with glasses is reading a newspaper in a café. The main headline reads "Today's AI news". American cartoon style.

Anatomie Humaine et Proportions

Bien que des progrès aient été réalisés, la génération d'anatomie humaine, en particulier des mains, reste un défi. SD3 produit des figures plus plausibles que SD1.5 ou SDXL, avec moins d'erreurs évidentes dans la structure des mains ou les proportions corporelles. Cependant, des prompts trop précis concernant des scènes complexes avec des humains peuvent encore entraîner des incohérences.

Prompt : A man and a woman on a snowmobile speed through an enviable landscape in the Swiss Alps. Realistic painting.

Dans des cas similaires, une itération répétée sur le même prompt avec un seed aléatoire peut aider à obtenir des résultats plus cohérents.

Rendu de l'Éclairage et des Matières

L'architecture du transformeur et les canaux VAE étendus permettent à SD3 de représenter plus précisément les effets d'éclairage subtils, les propriétés des matériaux et les relations de couleurs.

Diversité Stylistique

SD3 gère mieux la diversité des styles artistiques. Il est capable de suivre plus systématiquement des styles spécifiques (peinture à l'huile, aquarelle, art vectoriel, photoréalisme) tout en maintenant la fidélité au prompt.

Prompt : expressionist woman.

Prompt : typographic art woman.

Prompt : role-playing game (RPG) style fantasy city.

Disponibilité et Licences

Stable Diffusion 3 Medium a été publié en open source sous une licence communautaire (Stability Community License). Cette licence autorise l'utilisation pour la recherche, les usages non commerciaux et les usages commerciaux pour les organisations ou individus dont le revenu annuel est inférieur à 1 million de dollars USD.

Une licence d'entreprise payante est requise pour les entités dont les revenus annuels dépassent 1 million de dollars USD et qui utilisent les modèles Stability AI dans des produits ou services commerciaux.

Les modèles Stable Diffusion 3 et leurs flux de travail sont disponibles via la plateforme API de Stability, Stable Assistant et Discord via Stable Artisan.

Les poids du modèle Stable Diffusion 3 Medium sont disponibles en open source sous licence non-commerciale. Pour les droits commerciaux, une licence "créateur" à 20 dollars par mois est proposée aux professionnels répondant à certains critères de revenus et de financement.

Benchmark et Comparaisons

Des benchmarks réalisés par Stability AI et des tests utilisateurs mettent en évidence les forces et faiblesses de SD3 par rapport à d'autres modèles.

Comparaison avec DALL-E 3, Midjourney v6 et Ideogram v1

Dans les évaluations de préférence humaine, SD3 a surpassé ses concurrents en matière de typographie, offrant un rendu clair et lisible. En termes d'adhérence aux prompts, SD3 a égalé ou dépassé les concurrents dans le suivi d'instructions complexes.

Comparaison avec Flux et Modèles Chinois

Des modèles concurrents comme Flux, développé par d'anciens chercheurs de Stability AI, montrent des performances supérieures en évaluation humaine, particulièrement pour le suivi des prompts, la typographie et la précision anatomique. Flux produit moins d'artefacts et gère mieux les scènes complexes.

Des modèles chinois tels que Z-Image et Ovis-Image-7B présentent également une typographie impressionnante et une bonne adhérence aux prompts, tout en conservant une taille de modèle plus compacte (7 milliards de paramètres).

Comparaison avec les Modèles Propriétaires

Les modèles propriétaires comme DALL-E 3 (OpenAI), Gemini (Google) et Midjourney conservent des avantages en termes de performance "out-of-the-box", ne nécessitant pas de matériel local et bénéficiant d'améliorations continues.

Comparaison avec Adobe Firefly

Adobe Firefly cible les professionnels créatifs avec des données d'entraînement sous licence explicite, évitant ainsi les problèmes de droits d'auteur potentiels.

Évaluations Basées sur le Prix et la Vitesse

Les plateformes API proposent des comparaisons basées sur la latence, le temps de génération et le prix par image. Le temps de génération varie considérablement selon les modèles et les fournisseurs.

Utilisation et Cas d'Application

Stable Diffusion 3 Medium, grâce à son efficacité et son accessibilité, ouvre de nombreuses possibilités pour les créateurs et les entreprises.

Création de Contenu Rapide

Les équipes marketing utilisent SD3 pour la création rapide de contenu, générant des maquettes de produits, des graphiques pour les réseaux sociaux et des concepts publicitaires en quelques minutes.

Développement de Jeux Vidéo

Les développeurs de jeux tirent parti de SD3 pour le concept art et la génération d'assets, permettant d'itérer rapidement sur les designs de personnages, les concepts d'environnements et les variations d'objets.

Commerce Électronique

Les plateformes e-commerce génèrent des visualisations de produits à grande échelle, permettant aux détaillants de mode de créer des images de vêtements dans différentes couleurs, motifs ou contextes sans shootings coûteux.

Architecture et Design

Les cabinets d'architectes utilisent SD3 pour les présentations clients, transformant des rendus 3D bruts ou des croquis en visualisations photoréalistes.

Édition et Médias Numériques

Les éditeurs et créateurs de contenu génèrent des couvertures de livres, des illustrations d'articles et du contenu visuel pour les médias numériques.

Éducation et Formation

Les instructeurs créent des diagrammes, des illustrations et des exemples visuels personnalisés pour des leçons spécifiques.

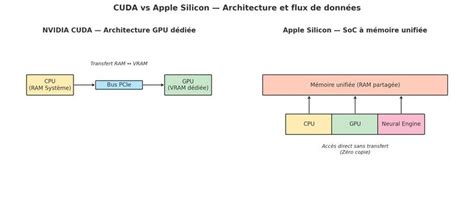

Consommation de Ressources et Configuration

L'un des avantages majeurs de Stable Diffusion 3 Medium est sa relative légèreté. Il ne nécessite que 5 Go de VRAM pour être exécuté, bien que Stability AI recommande environ 16 Go pour une utilisation optimale. Cela le rend accessible sur des configurations d'ordinateurs classiques dotés de GPU Nvidia de classe RTX.

Le modèle Large (8 milliards de paramètres) nécessite environ 24 Go de VRAM pour une génération confortable à une résolution de 1024x1024.

Des optimisations, comme la quantification INT8, réduisent de moitié les besoins en mémoire avec une perte de qualité minimale. Des techniques comme le CPU offloading permettent de faire fonctionner SD3 sur des systèmes avec une mémoire GPU insuffisante, bien que cela ralentisse considérablement la génération.

Installez le NOUVEAU Stable Diffusion 3 Medium en moins de 5 minutes

Enjeux Éthiques et Réglementaires

La sortie de SD3 soulève plusieurs questions éthiques et réglementaires importantes.

Données d'Entraînement et Droits d'Auteur

Comme les modèles précédents, SD3 a été entraîné sur des milliards d'images provenant d'Internet, dont beaucoup sans autorisation explicite des détenteurs de droits d'auteur. Le procès intenté par Getty Images contre Stability AI allègue une violation du droit d'auteur pour l'utilisation d'images de Getty dans l'entraînement.

Les décisions récentes, comme le règlement de 1,5 milliard de dollars dans l'affaire Bartz v. Anthropic, signalent une tendance vers l'indemnisation des détenteurs de droits pour les données d'entraînement.

Biais dans les Images Générées

SD3 présente des biais, notamment une préférence pour les teints de peau clairs et les représentations masculines lorsque les prompts ne spécifient pas de données démographiques.

Sécurité du Contenu et Usage Abusif

Malgré les filtres de sécurité intégrés, le modèle peut générer du contenu préjudiciable, y compris de la désinformation, du matériel explicite ou des images usurpant l'identité de personnes réelles. Le filtrage peut parfois bloquer des utilisations créatives légitimes, entraînant des faux positifs.

Stability AI justifie ces restrictions par des obligations réglementaires et le déploiement large de ses modèles.

Protection des Données et Confidentialité

L'exécution locale de SD3 offre un avantage en termes de confidentialité, car les données ne quittent pas le système de l'utilisateur.

L'Avenir de Stable Diffusion et de la Génération d'Images par IA

L'avenir de Stable Diffusion et du domaine de la génération d'images par IA s'annonce dynamique.

Développement Communautaire et Fine-Tuning

Les améliorations futures de SD3 dépendront probablement davantage des efforts communautaires que des mises à jour officielles de Stability AI. Les techniques comme Low-Rank Adaptation (LoRA) et le DreamBooth fine-tuning permettent d'entraîner SD3 sur des ensembles de données personnalisés avec peu d'exemples, ouvrant la voie à des modèles spécialisés.

La fusion de modèles permet de combiner différentes spécialisations pour créer des modèles hybrides.

Architectures Multimodales Futures

L'architecture transformeur de SD3 ouvre la voie au développement de modèles multimodaux plus avancés, capables de gérer le texte, les images et la vidéo dans des cadres unifiés.

Génération Vidéo

L'extension des modèles de diffusion d'images aux dimensions temporelles représente la prochaine étape logique, avec des recherches actives dans ce domaine.

Optimisation Matérielle et Accessibilité

L'intégration de l'accélération IA au niveau des puces par les fabricants de GPU rendra des modèles comme SD3 plus rapides et plus accessibles sur les appareils grand public.

Pressions Réglementaires

Des réglementations plus strictes concernant les données d'entraînement, la sécurité du contenu et la transparence façonneront le développement et le déploiement des modèles d'IA.

Conclusion

Stable Diffusion 3 représente une avancée significative dans la génération d'images par IA, offrant des performances améliorées en matière de compréhension des prompts, de rendu de texte et de qualité visuelle. Son architecture MMDiT et l'utilisation des Rectified Flows marquent une rupture avec les approches traditionnelles. Bien que des défis subsistent, notamment dans la génération d'anatomie humaine et les questions éthiques liées aux données d'entraînement et aux biais, la nature open source de SD3 et son accessibilité croissante en font un outil puissant pour la création et l'innovation.

tags: #stable #diffusion #3 #benchmark